- 入门教程

- 分类教程

- 回归教程

- 聚类教程

- KNN教程

支持向量机(SVM)是强大而灵活的有监督的机器学习算法,可用于分类和回归,但通常,它们用于分类问题。在1960年代,SVM首次推出,但在1990年得到了完善,与其他机器学习算法相比,SVM具有其独特的实现方式。最近,由于它们能够处理多个连续和类别变量,它们非常受欢迎。

SVM工作原理

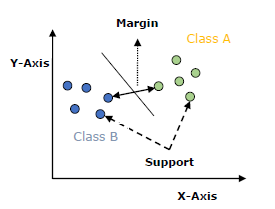

SVM模型基本上是多维空间中超平面中不同类的表示。 SVM将以迭代方式生成超平面,从而可以最大程度地减少误差。 SVM的目标是将数据集划分为几类,以找到最大边缘超平面(MMH)。

Support Vectors - 最靠近超平面的数据点称为支持向量。将在这些数据点的帮助下定义分隔线。

Hyperplane - 正如无涯教程在上图中所看到的,它是一个决策平面或空间,被划分为一组具有不同类的对象。

Margin - 可以将其定义为不同类别的壁橱数据点上的两条线之间的间隙。可以将其计算为从线到支持向量的垂直距离。

Python实现SVM

用于在Python中实现SVM - 将从如下所示的标准库导入开始-

SVM 内核

实际上,SVM算法是通过内核实现的,该内核将输入数据空间转换为所需的形式。 SVM使用一种称为内核技巧的技术,其中内核占用低维输入空间并将其转换为高维空间。简而言之,内核通过添加更多维度来将不可分离的问题转换为可分离的问题。它使SVM更加强大,灵活和准确。以下是SVM使用的某些内核类型。

Linear 内核

它可以用作任意两个观测值之间的点积。线性核的公式如下-

K(x,xi)=sum(x∗xi)

从上面的公式,可以看到两个向量之间的乘积是每对输入值的乘积之和。

Polynomial 内核

它是线性核的更广义形式,可以区分弯曲或非线性输入空间。以下是多项式内核的公式-

k(X,Xi)=1+sum(X∗Xi)^d

这里d是多项式的阶数,需要在学习算法中手动指定它。

RBF 内核

RBF内核(主要用于SVM分类)将输入空间映射到不确定的维空间中。以下公式数学上解释了它-

K(x,xi)=exp(-gamma∗sum(x-xi^2))

在这里, gamma 的范围是0到1,需要在学习算法中手动指定它,良好的默认值 gamma 为0.1。

在为线性可分离数据实现SVM时,可以在Python中为不可线性分离的数据实现SVM,可以通过使用内核来完成。

以下是使用内核创建SVM分类器的示例。将使用来自 scikit-learn 的 iris 数据集-

来源:LearnFk无涯教程网

将从导入以下包开始-

import pandas as pd import numpy as np from sklearn import svm, datasets import matplotlib.pyplot as plt

现在,需要加载输入数据-

iris=datasets.load_iris()

从该数据集中,采用以下两个特征:

X=iris.data[:, :2] y=iris.target

接下来,将用原始数据绘制SVM边界,如下所示-

x_min, x_max = X[:, 0].min() - 1, X[:, 0].max() + 1 y_min, y_max = X[:, 1].min() - 1, X[:, 1].max() + 1 h = (x_max/x_min)/100 xx, yy = np.meshgrid(np.arange(x_min, x_max, h), np.arange(y_min, y_max, h)) X_plot = np.c_[xx.ravel(), yy.ravel()]

现在,无涯教程需要提供正则化参数的值,如下所示:

C=1.0

接下来,可以如下创建SVM分类器对象-

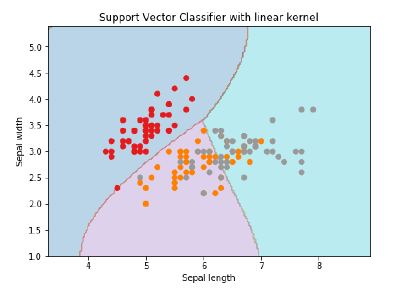

Svc_classifier=svm.SVC(kernel='linear', C=C).fit(X, y)

Z = svc_classifier.predict(X_plot) Z = Z.reshape(xx.shape) plt.figure(figsize=(15, 5)) plt.subplot(121) plt.contourf(xx, yy, Z, cmap=plt.cm.tab10, alpha=0.3) plt.scatter(X[:, 0], X[:, 1], c=y, cmap=plt.cm.Set1) plt.xlabel('Sepal length') plt.ylabel('Sepal width') plt.xlim(xx.min(), xx.max()) plt.title('Support Vector Classifier with linear kernel')

输出

Text(0.5, 1.0, 'Support Vector Classifier with linear kernel')

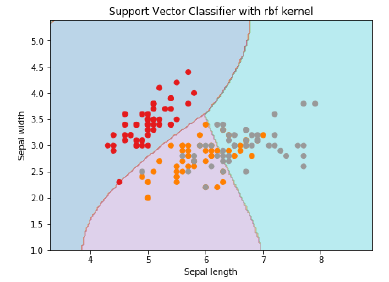

为了使用 rbf 内核创建SVM分类器,可以将内核更改为 rbf ,如下所示-

Svc_classifier = svm.SVC(kernel = 'rbf', gamma =‘auto',C = C).fit(X, y) Z = svc_classifier.predict(X_plot) Z = Z.reshape(xx.shape) plt.figure(figsize=(15, 5)) plt.subplot(121) plt.contourf(xx, yy, Z, cmap = plt.cm.tab10, alpha = 0.3) plt.scatter(X[:, 0], X[:, 1], c = y, cmap = plt.cm.Set1) plt.xlabel('Sepal length') plt.ylabel('Sepal width') plt.xlim(xx.min(), xx.max()) plt.title('Support Vector Classifier with rbf kernel')

输出

Text(0.5, 1.0, 'Support Vector Classifier with rbf kernel')

无涯教程将gamma的值设置为"auto",但您也可以提供0到1之间的值。

SVM优缺点

SVM分类器的优点 - SVM分类器具有很高的准确性,并且可以在高维空间中很好地工作。 SVM分类器基本上使用训练点的子集,因此输出使用的内存非常少。

SVM分类器的缺点 - 它们训练时间长,因此在实践中不适合大型数据集。另一个缺点是SVM分类器不能与重叠的类一起很好地工作。

祝学习愉快!(内容编辑有误?请选中要编辑内容 -> 右键 -> 修改 -> 提交!)

《Python机器学习入门教程》

《Python机器学习入门教程》